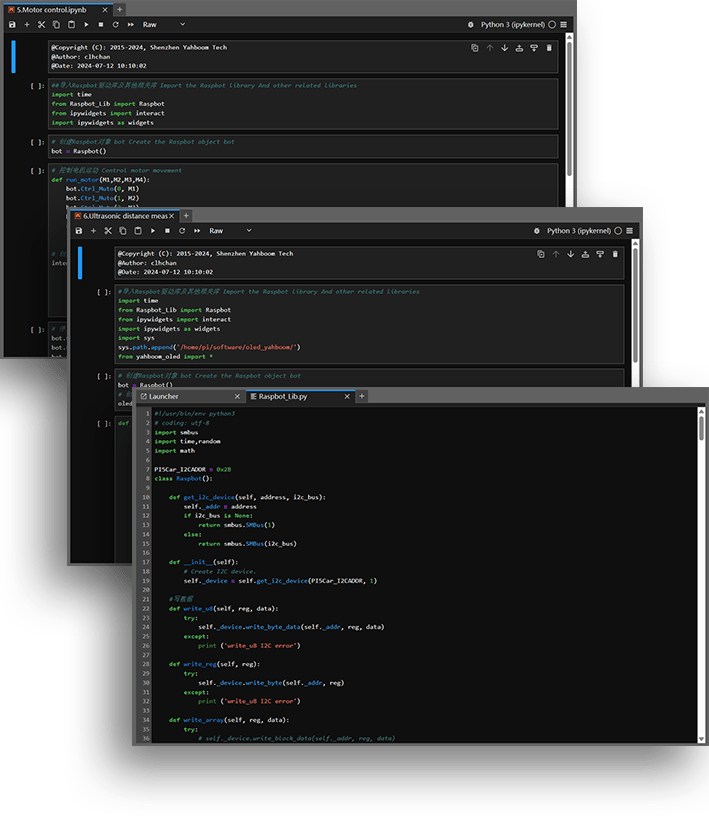

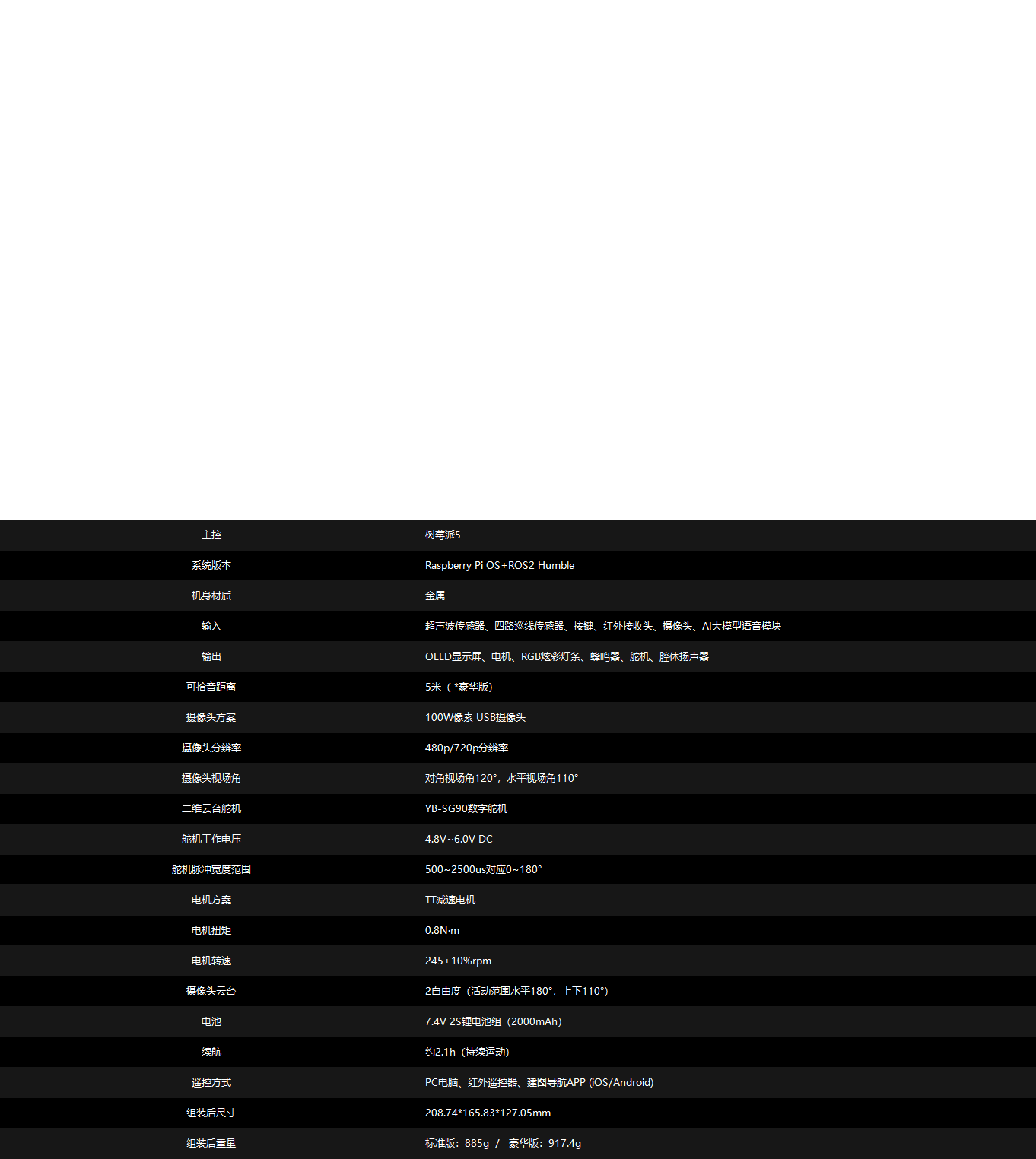

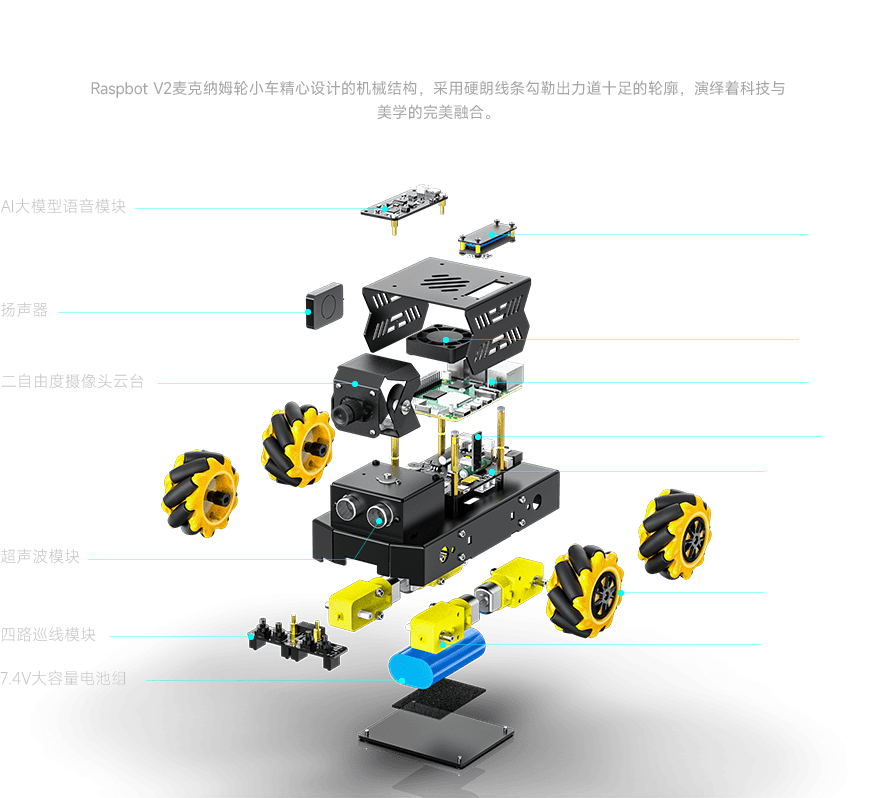

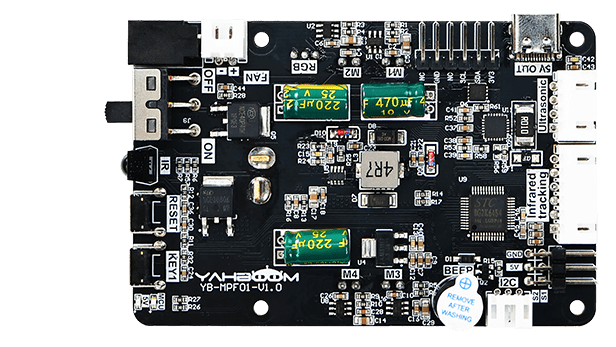

搭载树莓派5机器人驱动板,通过I2C与树莓派5通信,从而驱动舵机、电机、传感器等多种外设。Type-C供电接口支持树莓派5 PD(5V/5A)供电规范,出厂自带外设驱动固件程序,用户可直接调用驱动API,使用简单又高效。

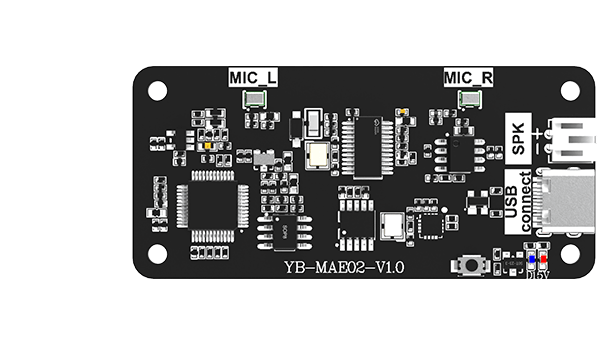

AI语音大模型模块集成高灵敏MEMS麦克风,搭配腔体扬声器,能够对语音进行清晰的拾取与播报,具有远场拾音、回声消除、环境降等功能。

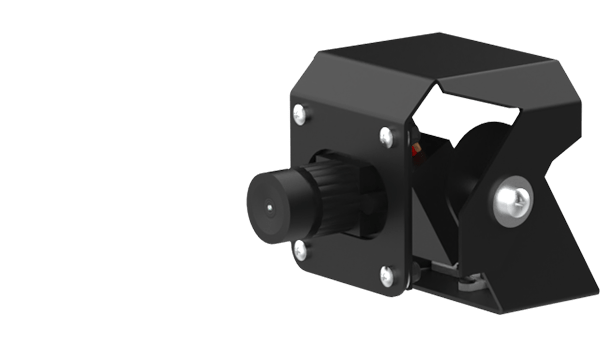

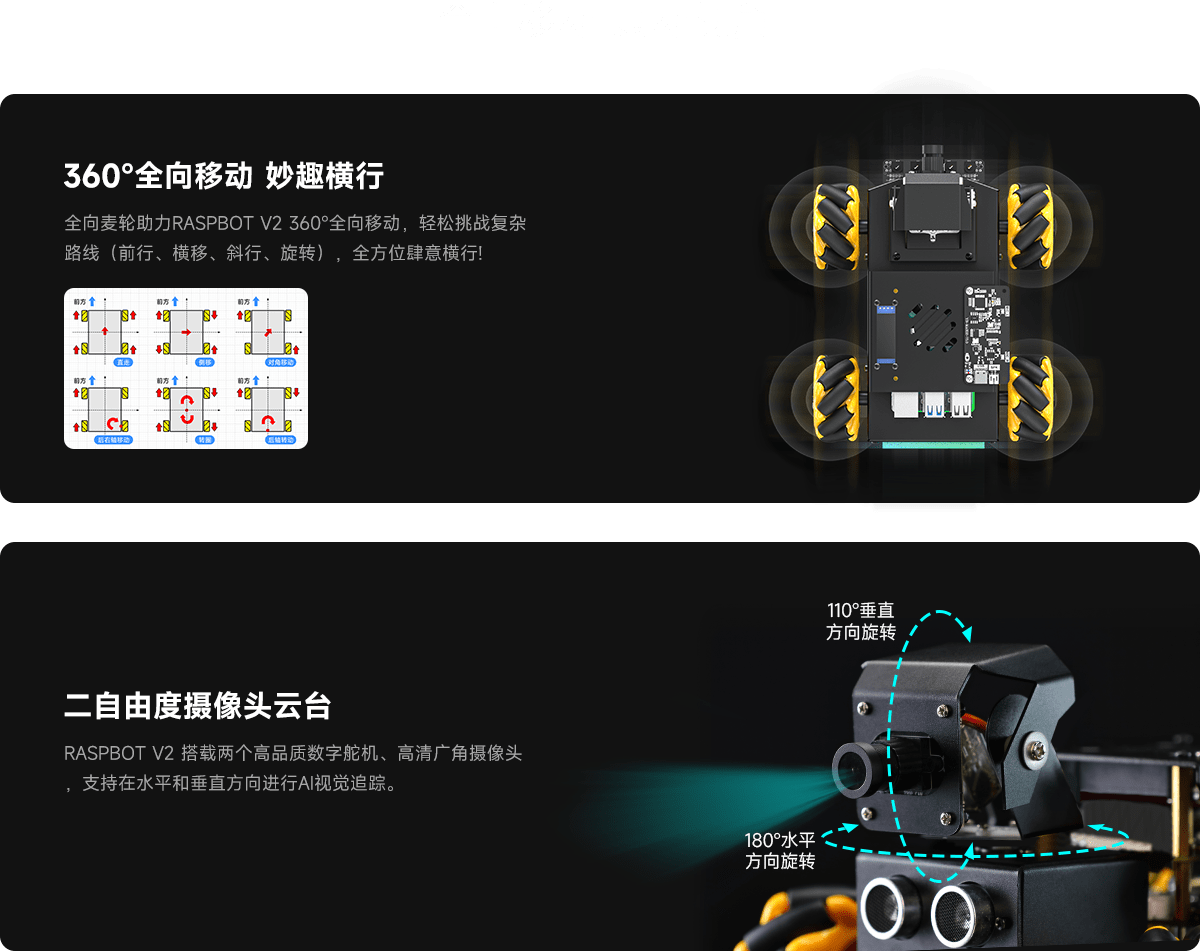

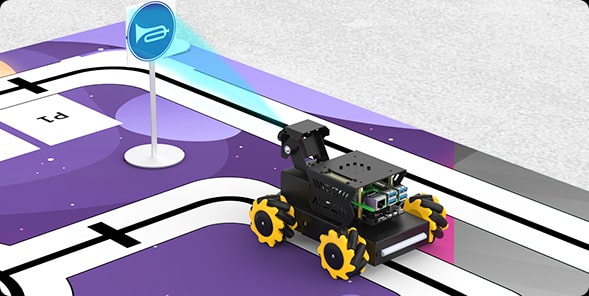

二自由度云台采用高品质数字舵机,实现精度更高,寿命更长,支持在水平和垂直方向上灵活移动。

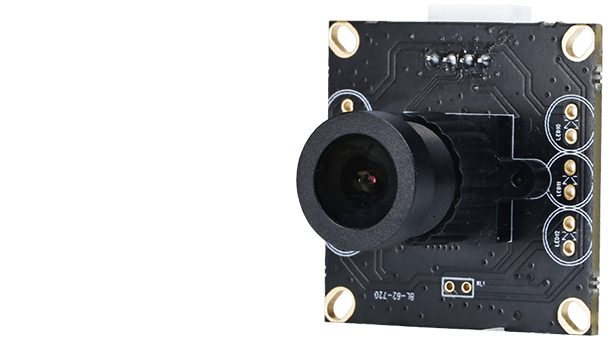

搭载110度广角摄像头,100万图像像素,配合灵活运动的小车,视觉范围可达360°全方位无死角。

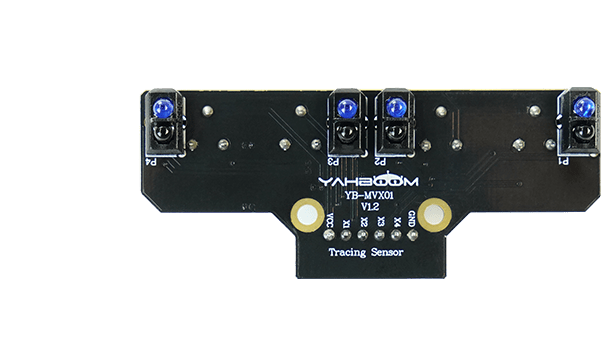

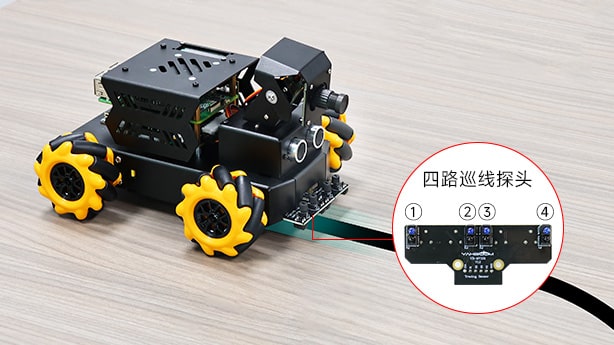

红外循迹传感器搭配4路高精度红外探头,旋钮式距离调节,可实现直角转弯、交叉路段等高难度循迹。

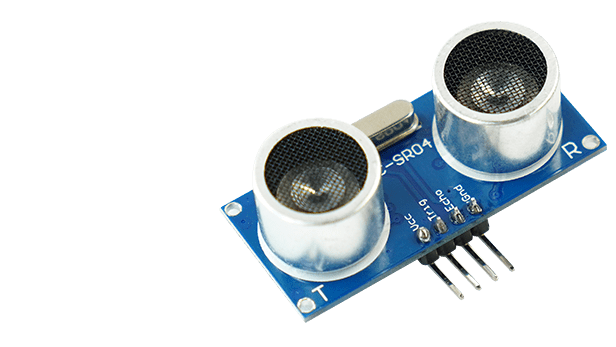

板载超声波传感器,支持实现超声波测距、避障、跟随等运动。

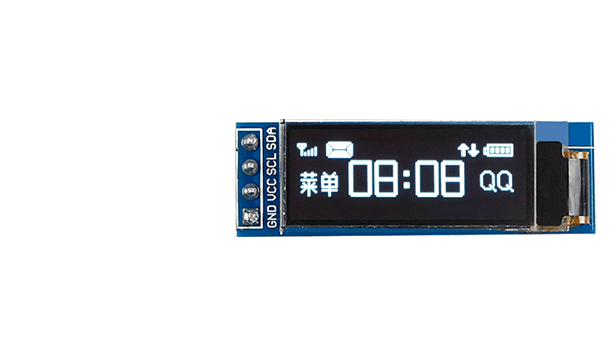

支持显示小车的内存、IP等状态信息,并能与传统传感器及AI视觉交互,将识别结果实时显示在OLED屏幕上。

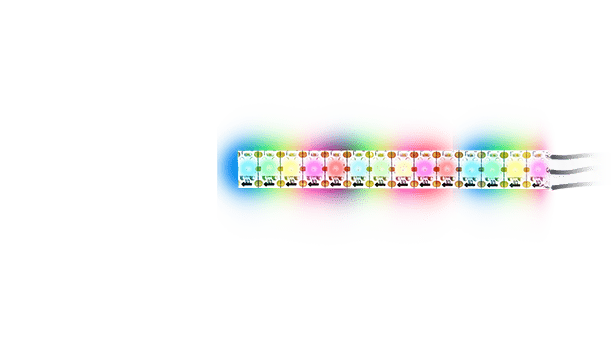

尾部配备了RGB高亮炫彩灯条,支持多种灯效控制,包括颜色变换、亮度调节、跑马灯、渐变灯、流水灯以及呼吸灯等灯效。

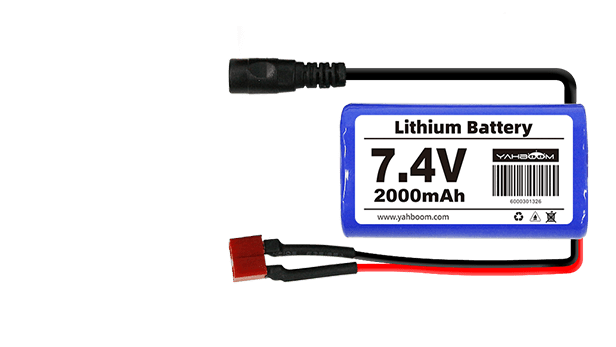

配备2000mAh容量7.4V 2S锂电池组,整车续航时长约2.1小时,锂电池设计有专属保护仓,避免底盘磕碰撞击电池。

-min.png)

-min.png)

-min.png)

-min.png)

-min.png)

-min.png)

-min.png)

-min.png)

-min.png)

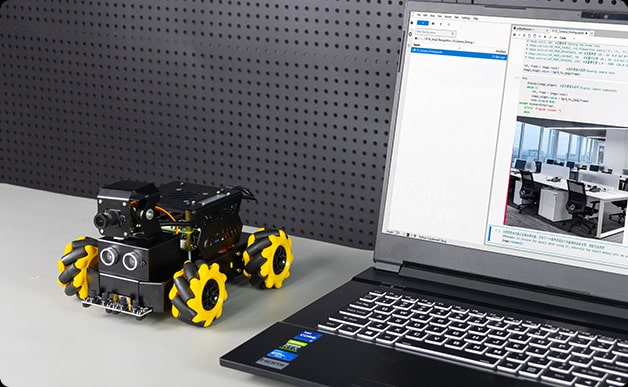

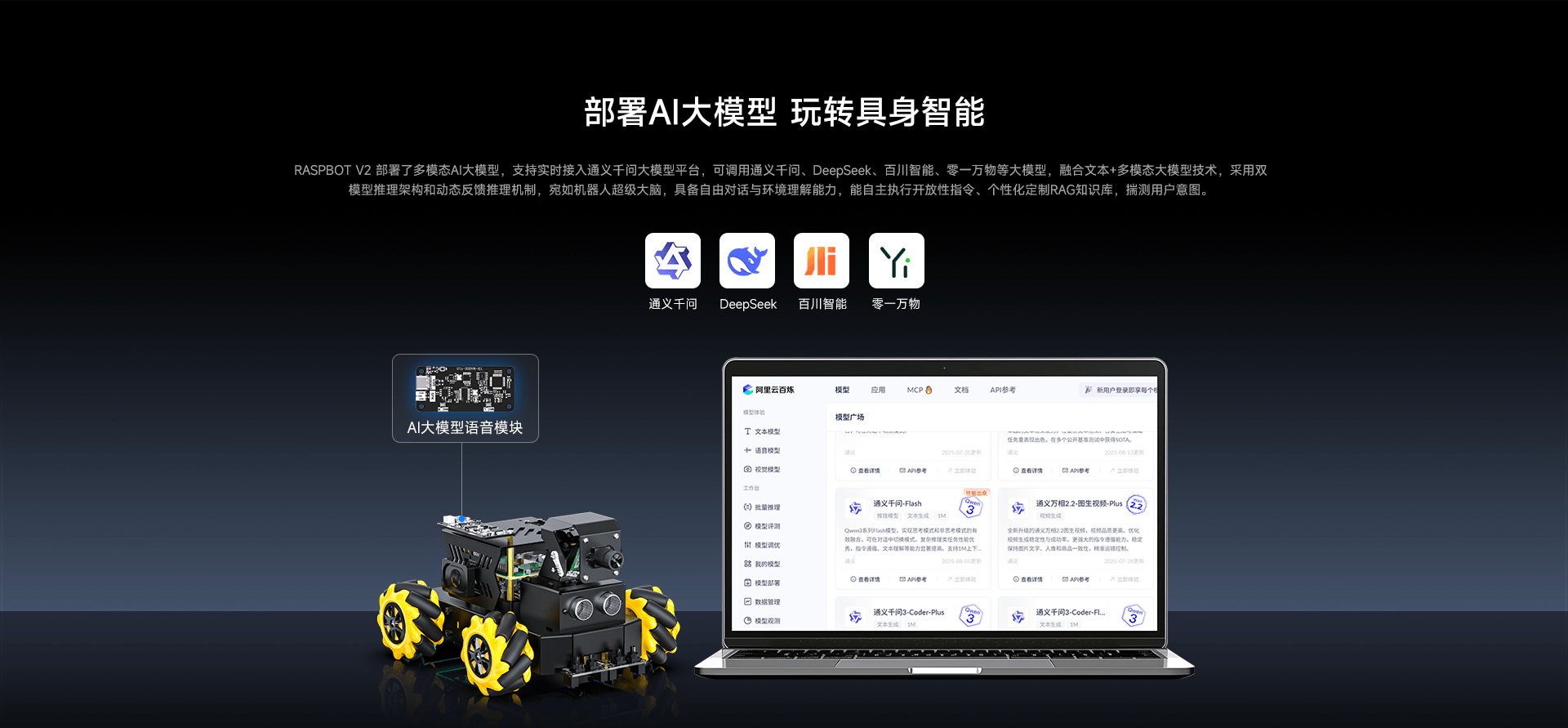

RASPBOT V2 实时接入通义千问大模型平台,宛如配备“超级大脑”,不仅能理解文本指令,还能灵活应答。

RASPBOT V2 搭载AI大模型语音模块和扬声器,支持语音与文字实时互转,接入通义千问后,能“听“会“说”,实现智能交互体验。

RASPBOT V2 搭载 USB 高清摄像头,能够理解和分析图像内容,精准识别物体并输出文本和语音反馈。

-min.png)

-min.png)

-min.png)

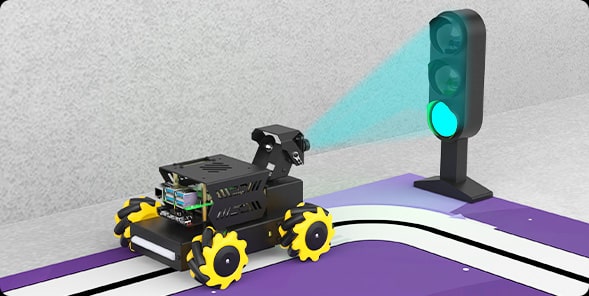

通过大语言模型的语义理解,RASPBOT V2能够精准识别并实时追踪各种颜色的线条。

借助视觉大模型的强大分析能力,RASPBOT V2 能够在复杂环境中自动识别并锁定目标物品,实现云台追踪或小车跟随任务

-min.png)

-min.png)

-min.png)

通过大模型与小车机身硬件联动,实现语音控制、自主避障、动态巡线与灯条交互构建集感知、决策与动作为一体的智能全向移动小车。

通过视觉大模型,PASPBOT V2 能理解视野内的场景,根据数据库模型判断环境明暗度、物品名称与特性,并通过大语言模型输出文本或语音反馈。

小车能够准确识别车牌号码,并实时将识别结果呈现在 OLED 显示屏上。

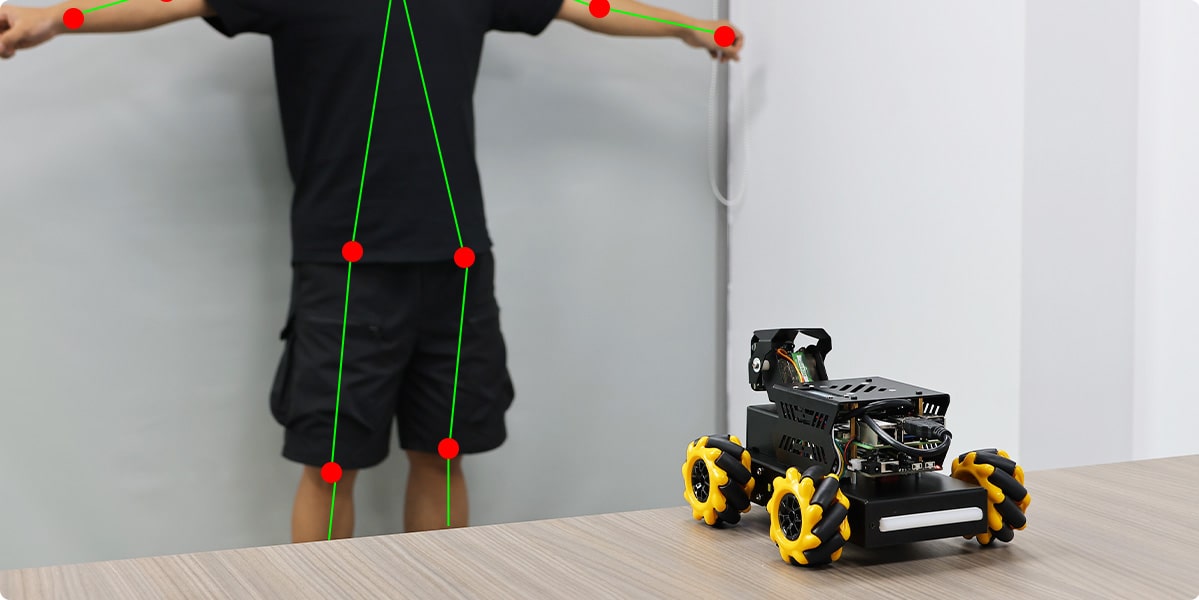

通过 MediaPipe 机器学习框架,可以精准地标记出人体的 33 个关键点坐标。

集成轻量级 YOLOv5-Lite 模型,能够快速准确地识别周围环境中的物体。

支持识别积木块上的垃圾类型,并实时将识别结果呈现在 OLED 显示屏上。

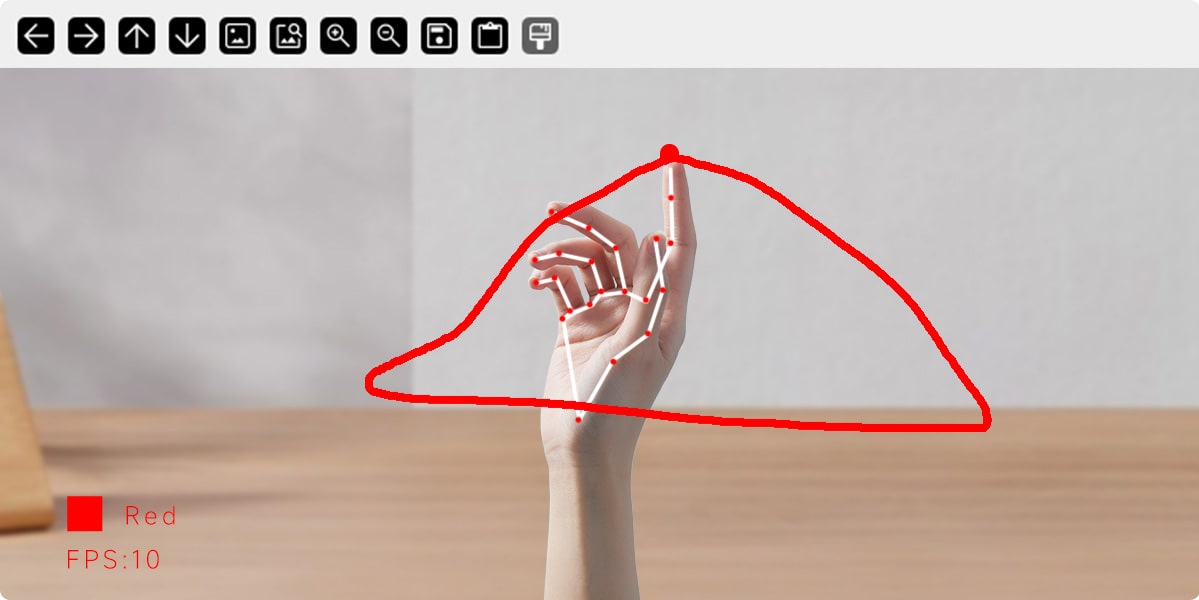

通过识别手指关键点坐标来检测指尖位置,进而实现在摄像头画面中绘制线条。

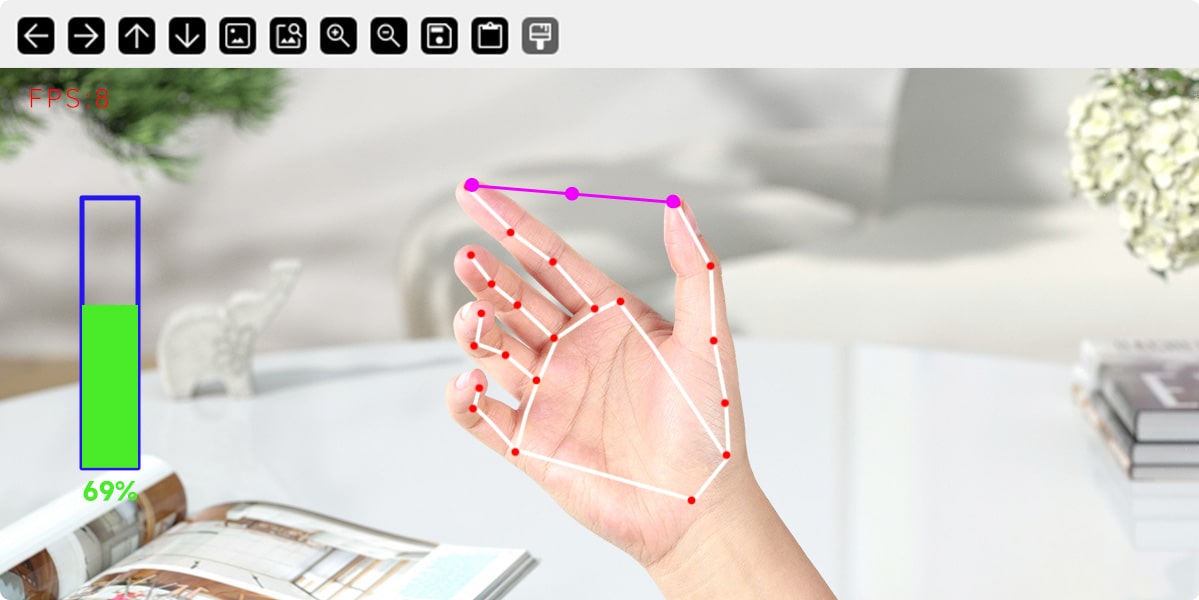

通过识别手指关键点坐标来检测拇指与食指的距离(张/合),实现控制图像的效果。

使用OpenCV实现颜色识别,当检测到目标颜色时,系统能通过控制舵机云台上下左右运动追踪颜色,也支持驱动车身前后左右运动跟随颜色。

采用OpenCV进行人脸识别,一旦捕捉到人脸,系统能通过控制舵机云台上下左右运动追踪人脸,也支持驱动车身前后左右运动跟随人脸。

支持识别14类手势动作,通过手势可控制小车前后左右运动。

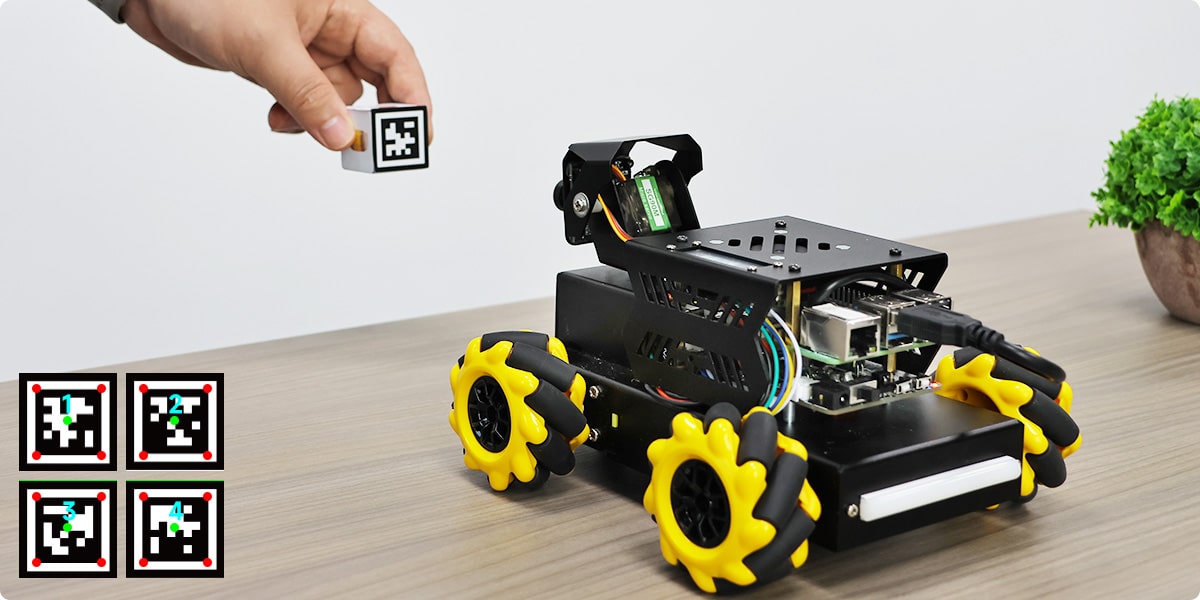

识别并读取二维码信息,RASPBOT-V2将根据获取信息执行相应运动。

支持识别AprilTag标签码,实现对标签码的云台跟踪以及小车跟随。

-min.png)

-min.png)

-min.png)

-min.png)

-min.png)

-min.png)

当接收到“这是什么颜色”的语音提问时,小车可实时采集前方画面,分析目标物体颜色,并通过语音反馈识别结果。

可通过语音指令调节小车灯带显示效果支持单色控制(红/绿/蓝/黄)及多种动态模式,如流水灯、渐变灯、呼吸灯。

支持通过预设语音指令(固定词条)控制小车的运动状态,包括前进、后退、左转、右转和停止。

支持通过语音控制小车进行指定颜色的巡线任务,可识别红色/绿色/蓝色/黄色等不同颜色的引导线并自主行驶。

可通过语音指令触发物体追踪功能,支持对指定颜色目标(红/绿/蓝/黄)和人脸进行动态跟踪。

通过OpenCV提取ROI区域,通过模糊处理消除噪点,在二值化图像中找出线条的位置,利用PID算法对机器人进行方向的校准,实现AI视觉巡线。

通过巡线传感器上的4个红外探头,进行路线探测,巡线行驶。

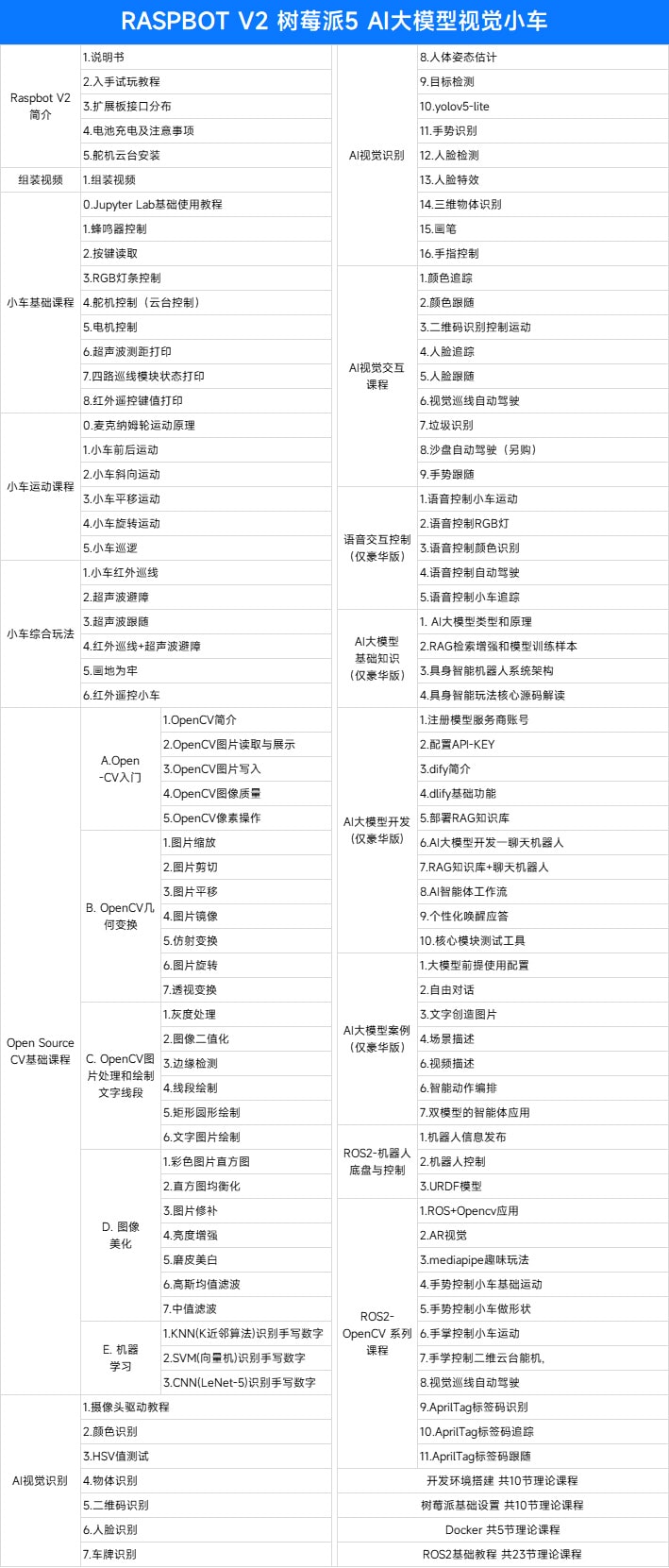

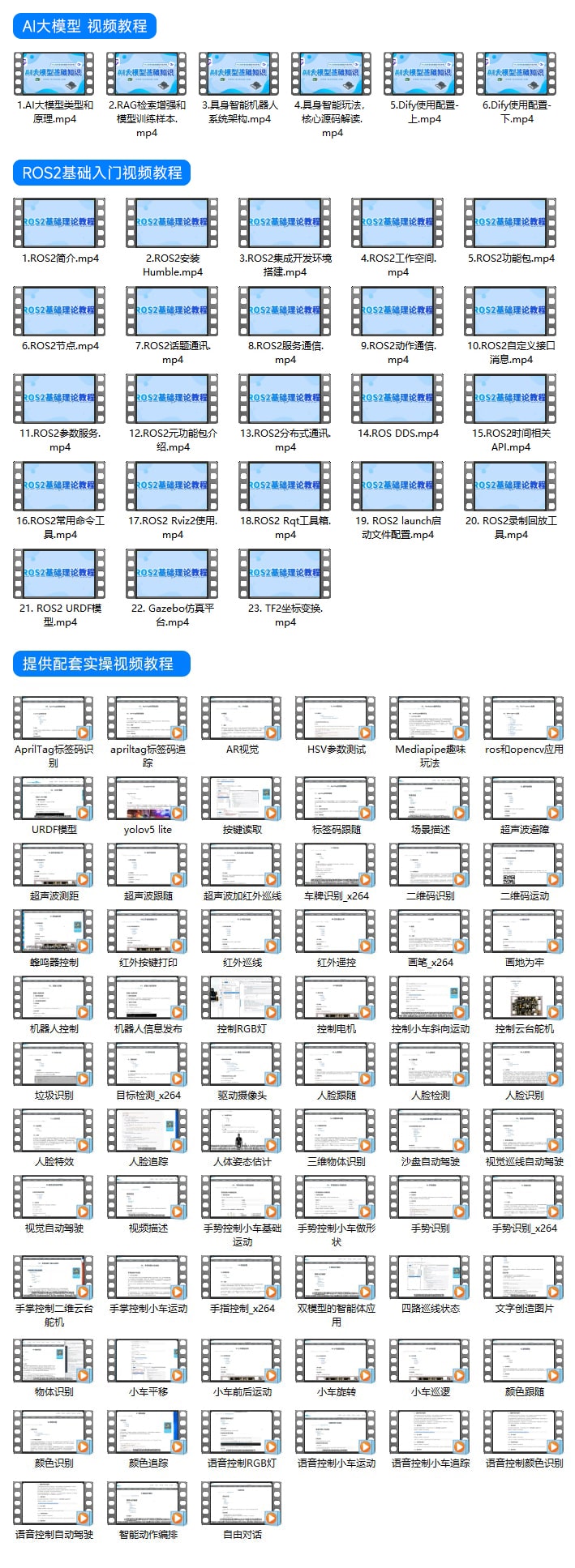

亚博智能配备精心研发的配套课程资料,提供基础理论知识与实操案例教程,内容由浅入深,方便用户快速上手学习。

原创59课实操视频教程,资深工程师手把手带您玩转Raspbot V2。

程序代码开源,让技术更自由,让创新更简单。