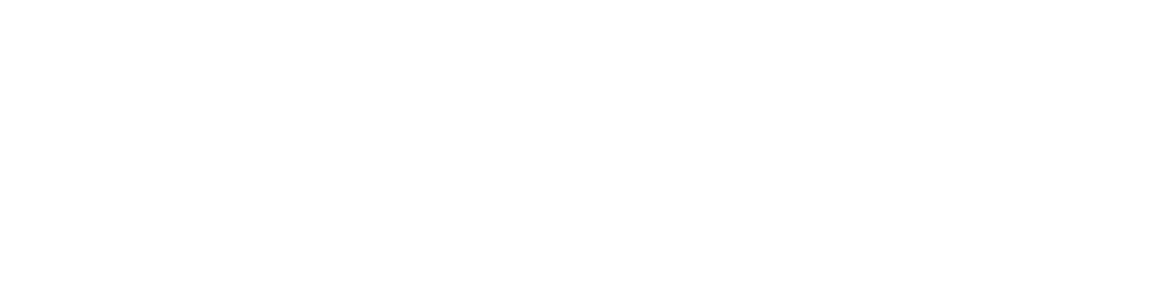

200W高清摄像头云台搭载2个高品质数字舵机,支持180°水平环视与100°垂直俯仰配备200万像素高清摄像头,可实现人脸识别、颜色识别、人体检测等AI视觉功能,支持云台追踪,提升动态交互体验。

3D深度相机采用3D成像技术,工作距离0.2-4m,水平视场角达73.8°,支持俯仰角调节兼容高清摄像头AI功能,同时可实现3D深度数据处理、三维建图与导航等进阶应用。

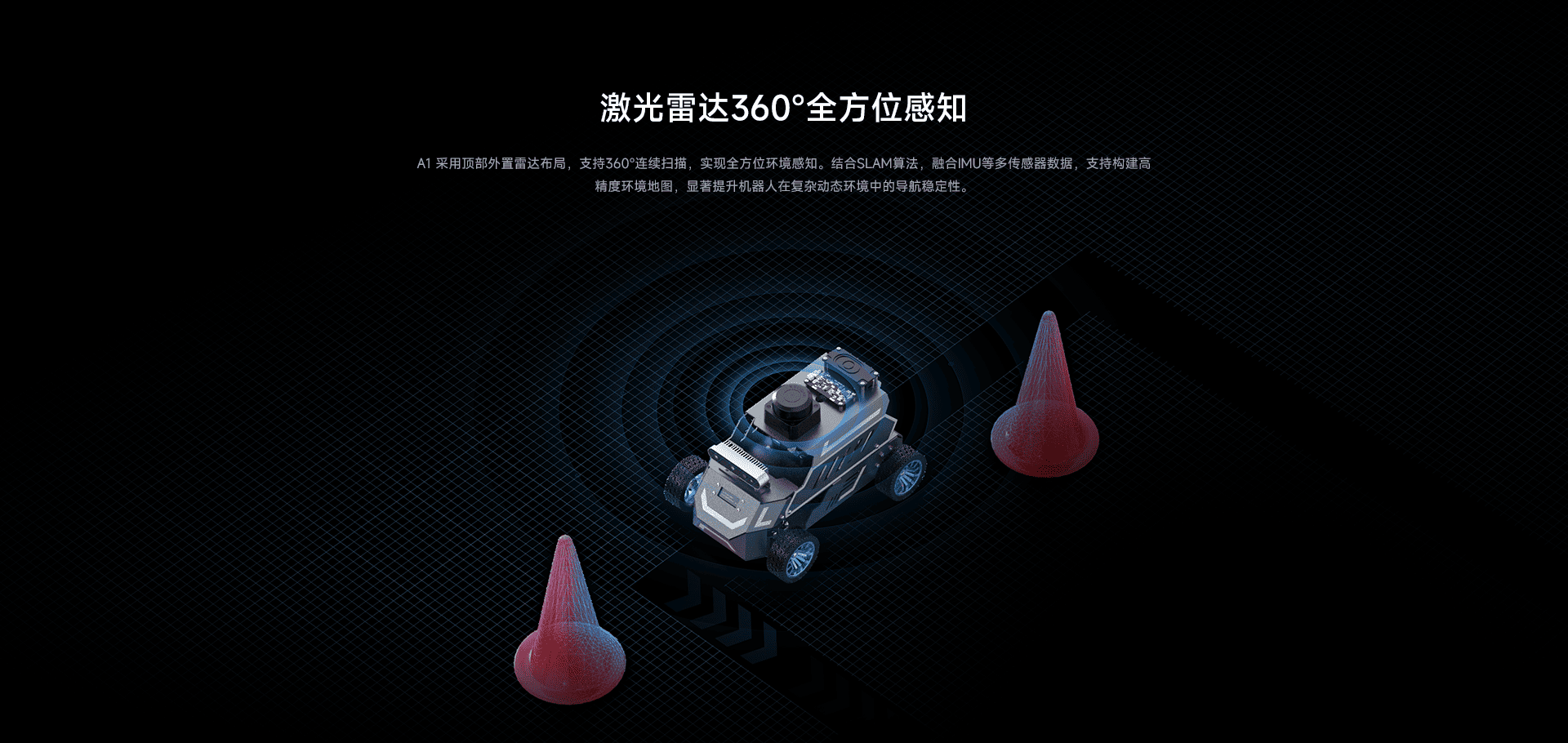

标准/豪华版:采用 T-MINI PLUS,兼顾小巧与高精度设计,适合入门级学习使用。旗舰版:搭载思岚 C1,提供更高采样率与系统稳定性,适应复杂应用场景。两款雷达均可实现建图、导航、避障等各种功能。

AI语音大模型模块是连接用户语音输入与智能模型决策的核心枢纽,模块配置了高灵敏MEMS麦克风搭配腔体扬声器,能够对语音进行清晰的拾取,具有远场拾音、回声消除语音播报、环境降噪等功能。

专为ROS机器人小车开发设计,可控制驱动麦轮、阿克曼、四轮差速、两轮差速、全向轮、履带等机器人底盘,支持树莓派5供电协议,满足各ROS主控供电需求,驱动代码及硬件原理图均开源。

配备12.6V 6000mAh锂电池组,具有过冲、过放、短路、过流、低压、过压保护功能电芯安全可靠,电池容量大,续航持久。

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

.png)

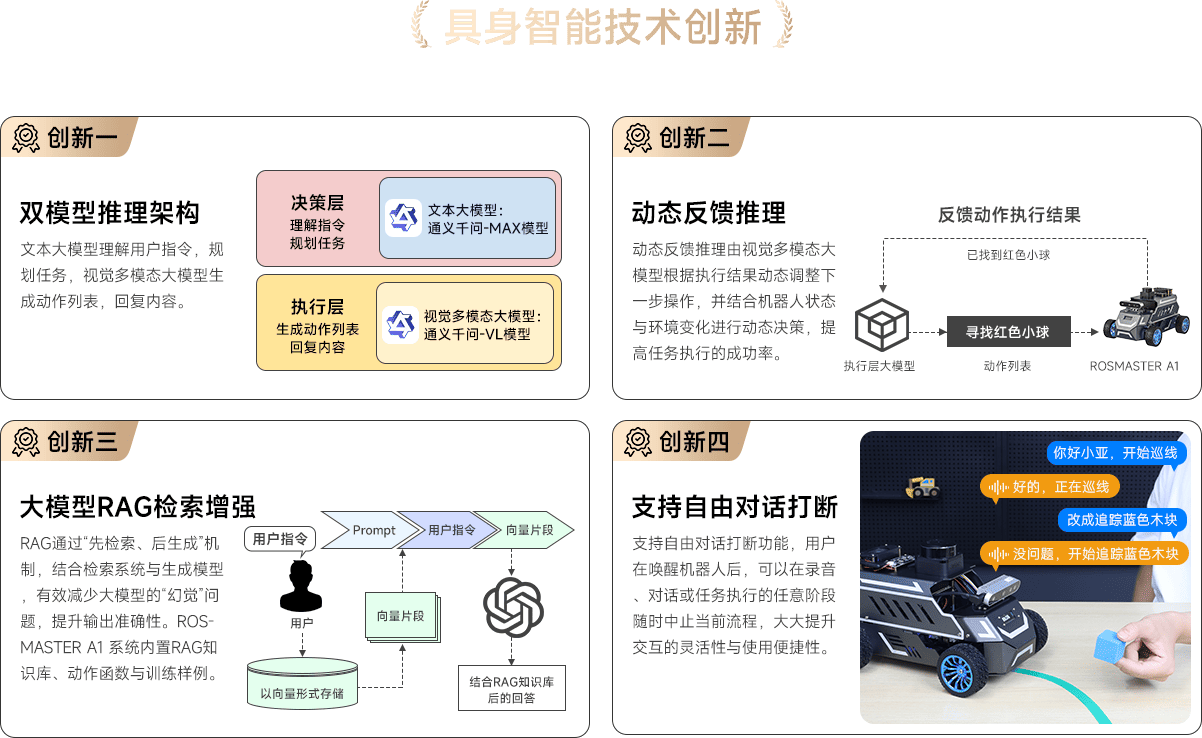

ROSMASTER A1 实时接入通义千问大模型平台,宛如配备“超级大脑",不仅能理解文本指令,还能灵活应答。

ROSMASTER A1 搭载AI大模型语音模块和扬声器,支持语音与文字实时互转,接入通义千问后,能“听“会“说”,实现智能交互体验。

ROSMASTER A1 搭载深度相机或高清摄像头,能够理解和分析图像内容,精准识别物体,并输出文本和语音反馈。

.png)

.png)

.png)

.png)

.png)

通过视觉大模型,A1能理解视野内的场景信息,识别物体名称与空间关系并通过语音大模型实时答复。

借助视觉大模型的强大分析能力,A1能够在复杂环境中自动识别并锁定目标物品,通过云台进行追踪或驱动车体进行智能跟随。

通过视觉大模型的深度分析,A1能够精准识别并实时追踪不同颜色的线条,实现自主巡航。

通过大模型与深度相机的协同工作,A1 具备环境理解与距离感知能力,能够结合视觉识别内容与距离数据进行智能问答。

.png)

-min.jpg)

-min.jpg)

-min.jpg)

-min.jpg)

通过视觉大模型分析,A1能够深入理解地图不同区域内的物品、空间布局。

A1 可以实时回传环境数据至视觉大模型进行深度分析,并根据用户不同的语音指令自适应动态路径规划,自主导航至单个或多个指定区域,从而实现智能多点导航。

通过语音大模型推理和视觉大模型分析,A1 能够精准识别并分析用户的语音指令,深层次理解指令含义并自主规划完成对应任务。

借助视觉大模型的强大分析能力,A1能够在自动驾驶沙盘地图中识别路标,并根据路标指示执行对应动作。

.png)

-min.jpg)

-min.jpg)

-min.jpg)

通过融合视觉理解、语音意图识别与SLAM动态路径规划,A1能够拆解用户下达的复杂指令,实时感知环境变化,并完成识别、追踪、导航、问答等一系列连贯操作。

通过扩展RAG知识库实现用户意图识别与环境情境分析,无需发布详细的指令,机器人即可自行理解用户的潜在需求,自主进行任务规划与动态响应。

通过融合多模态大模型、视觉自动驾驶模型与 ROS2 路网规划系统,A1能在沙盘地图环境中实现高度智能化的自动驾驶。不仅能理解用户下达的语音指令,结合路网拓扑结构自主规划最优路径,还能在行驶过程中实时识别沙盘中的路标信息,理解交通规则,精准抵达目标,高效完成指定任务。

.png)

.png)

.png)

.png)

.png)

-min.png)

.png)

配备高精度TOF激光雷达,融合编码器和IMU陀螺仪数据,能实现高精度的建图导航。支持多种建图算法,具备单点/多点导航功能,可通过APP进行建图导航操作。特别优化重定位导航技术,显著降低运行中的定位漂移,提升导航稳定性与可靠性。

3D结构光深度相机可生成深度图像和点云数据,精准获取目标物体的深度信息,实现距离及体积的精确测算。结合雷达数据,可构建高精度三维彩色地图,支持更精准的环境感知与智能导航。

内置YOLOv11深度学习模型,支持图像分割、姿态估计、图像分类与定向物体检测等案例,赋予机器人更强大的环境感知与决策能力。配套提供完整的模型训练与部署教程助力开发者快速定制专属视觉应用。

集成多种主流图像处理算法,支持OpenCV、MediaPipe等框架,可高效识别多种目标物体,助力开发者快速构建高性能计算机视觉应用。

将视觉算法与小车运动控制相结合,实现高效目标追踪。云台负责锁定目标,小车同步移动跟随:深度相机版本可实现距离感知的立体化跟随。

支持多台机器人同地图多点导航巡航与动态避障,实现多机同步控制及队列表演。可通过一台主机同步控制多台机器人

-min.jpg)

-min.jpg)

-min.jpg)

-min.jpg)

.png)

.png)

.png)

教程详细 开放源码

亚博智能配备精心研发的配套课程资料,提供基础理论知识与实操案例教程,内容由浅入深,方便用户快速上手学习。

原创中英文视频教程,资深ROS工程师手把手带您玩转ROSMASTER A1。

提供源码解析,同时配备资深工程师手把手带您玩转ROSMASTER A1。