AI大模型原理基础

本章节只讲述多模太AI大模型相关的知识理论,没有兴趣的可以忽略本节。 本节不涉及机器狗的操作使用。

AI大模型的产生

1. 技术架构演进

- 多模态大模型的核心在于整合文本、图像、音频、视频等多源数据,其架构经历了从单一模态到跨模态融合的转变:

- 早期单模态模型:如AlexNet(图像分类)、BERT(文本处理)等,仅针对单一任务设计,需独立训练不同模型。

- Transformer与大语言模型(LLM)的突破:通过统一框架(如GPT系列、CLIP)实现跨模态语义对齐,将不同数据映射到同一语义空间,减少信息损失。

- 端到端多模态建模:如GPT-4o、Google Gemini,通过单一模型直接处理多模态输入输出,消除中间转换步骤,提升效率。

- 关键组件与训练方法

- 编码器(Encoder):将不同模态数据(如图像像素、音频波形)转换为统一的高维特征向量,例如视觉编码器提取图像语义,文本编码器生成词嵌入。

- 跨模态注意力机制:动态调整各模态权重,例如微软BEiT-3通过跨模态注意力实现文本与图像的深度关联5。

- 预训练与微调:在大规模多模态数据(如LAION-5B)上进行预训练,再针对下游任务(如机器人控制、医疗诊断)微调,提升泛化能力。

- 跨模态对齐与知识融合

- 对齐技术:如CLIP通过对比学习对齐图像与文本特征,实现开放词表的零样本分类。

- 外部知识增强:模型如KOSMOS-1引入医学知识库,提升复杂问答的准确性。

2. AI大模型应用层次

- 机器人及具身智能

- 通用化机器人:多模态LLM赋予机器人自主推理与学习能力,如特斯拉Optimus通过视觉、触觉等多传感器融合,适应非结构化环境。

- 实时交互与控制:谷歌RT-2模型将多模态输入直接转化为行动编码,在未知任务中成功率显著提升。

- 行业案例:波士顿动力Spot在博物馆担任导游,强调交互娱乐性而非纯功能性。

- 生成式内容创作 文生视频与3D建模:OpenAI Sora可生成高保真视频,Stable Diffusion 3支持3D内容生成,推动影视、游戏行业革新。 数字人与虚拟助手:如谷歌Project Astra、腾讯MM-LLMs,实现自然对话与实时视频剪辑。

3.垂直行业深度渗透 医疗诊断:数坤科技“数字人体”平台融合医学影像与病历文本,提升诊断效率5。 工业质检:多模态模型结合合成数据,检测复杂缺陷,错误率降低90%。 金融反欺诈:跨模态关联分析(如语音+交易记录)准确率达98%。

3.总结

多模态大模型通过统一架构与跨模态融合,正在重构AI的能力边界,其应用从机器人到医疗、金融等领域展现出巨大潜力。 未来,技术需在算力优化、伦理治理、模态扩展等方面持续突破,以实现“人机共生”的愿景。

4.机器狗多模态的应用示例

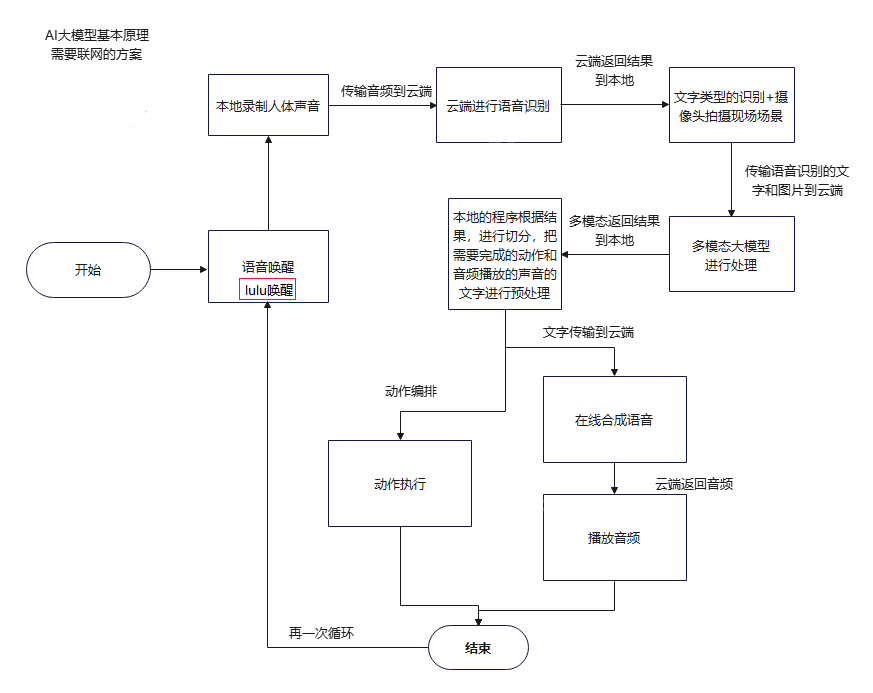

机器狗的具身智能多模态结合在线平台方案如下: